【优化算法】1. 深度学习优化算法介绍

概论

本文主要介绍深度学习与优化的关系,以及优化在深度学习使用中的问题和挑战。解决一个深度学习问题的基本步骤:

- 定义损失函数。

- 使用优化算法最小化损失。优化过程中,损失函数就是优化算法的目标函数。

通常我们优化的目标是最小化,当遇到最大化问题时,我们可以给目标函数加个负号。

优化的目标

虽然优化算法是深度学习中用来减少损失函数的方法,但是优化算法和深度学习的目标是不同的。

- 优化的目标是减少训练误差,最小化目标函数是基于训练集的损失函数。

- 深度学习的目标是减少泛化误差,是在有限数据集上寻找到合适的模型。

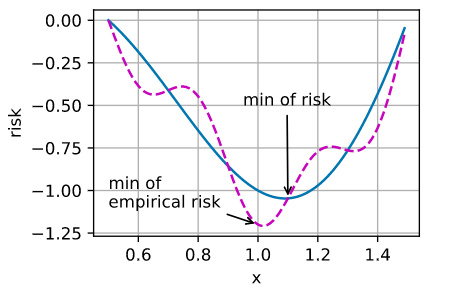

深度学习,除了训练模型时使用优化算法减少训练误差,还需要解决过拟合问题。我们进一步说明下这两个目标的区别,这里需要介绍下经验风险(empirical risk)和 真实风险(true risk)。经验风险时训练数据集的评价损失,真实风险时整个数据集的预期损失。我们定义经验风险函数

g

g

g和实际风险函数

f

f

f,在训练数据集中最低的经验风险可能与最低的真实风险(泛化误差)是不同的。

优化的挑战

优化算法的目标是减少训练误差,因此我们这里只关注最小化目标函数方面的挑战,暂时不关注泛化误差。深度学习优化存在的挑战有局部最小值、鞍点和梯度消失等。

局部最小值

对于任何目标函数

f

(

x

)

f(x)

f(x),如果在

x

x

x处对应的

f

(

x

)

f(x)

f(x)值小于在

x

x

x附近任何其他点的

f

(

x

)

f(x)

f(x)值,那么

f

(

x

)

f(x)

f(x)可能是局部最小值。如果

f

(

x

)

f(x)

f(x)在

x

x

x处的值是整个域上目标函数的最小值,那么

f

(

x

)

f(x)

f(x)是全局最小值。

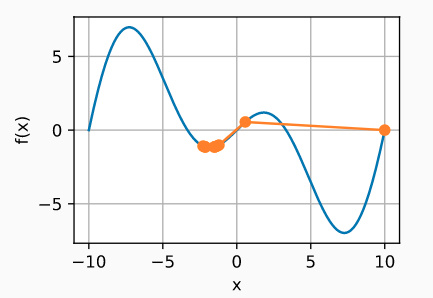

深度学习模型的目标函数通常有许多局部最优解。当优化问题的数值解接近局部最优值时,随着目标函数解的梯度接近或变为零,通过最终迭代获得的数值解可能仅使目标函数局部最优,而不是全局最优。

一定程度的噪声可能会使参数超出局部最小值。事实上,这是小批量随机梯度下降的有利特性之一,在这种情况下,小批量上梯度的自然变化能够将参数从局部极小值中移出。

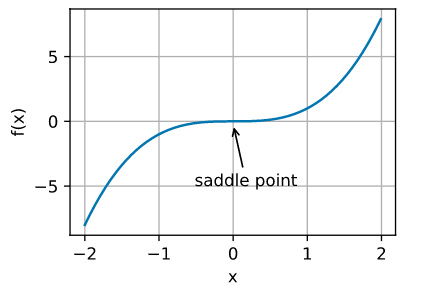

鞍点

鞍点也是梯度消失的另一个原因,鞍点(saddle point)是指函数的所有梯度都消失但既不是全局最小值也不是局部最小值的任何位置。考虑这个函数

f

(

x

)

=

x

3

f(x) = x^3

f(x)=x3。它的一阶和二阶导数在

x

=

0

x=0

x=0时消失。这时优化可能会停止,尽管它不是最小值。

我们假设函数的输入是

k

k

k维向量,其输出是标量,因此其Hessian矩阵(也称黑塞矩阵)将有

k

k

k特征值(参考online appendix on eigendecompositions)。函数的解决方案可以是局部最小值、局部最大值或函数梯度为零的位置处的鞍点:

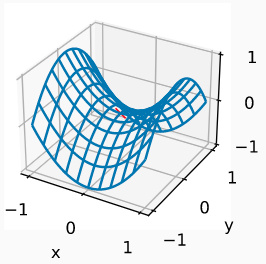

- 当函数在零梯度位置处的Hessian矩阵的特征值全部为正值时,我们有该函数的局部最小值。

- 当函数在零梯度位置处的Hessian矩阵的特征值全部为负值时,我们有该函数的局部最大值。

- 当函数在零梯度位置处的Hessian矩阵的特征值为负值和正值时,我们对函数有一个鞍点。

对于高维度问题,至少部分特征值为负的可能性相当高。这使得鞍点比局部最小值更有可能。凸函数是Hessian函数的特征值永远不是负值的函数。不幸的是,大多数深度学习问题并不属于这个类别。尽管如此,它还是研究优化算法的一个很好的工具。

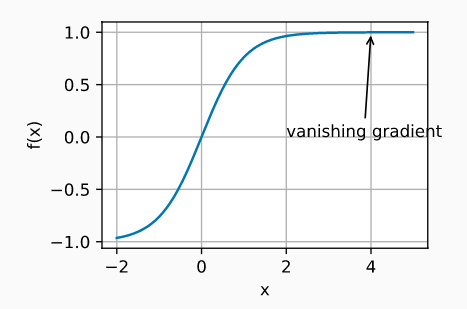

梯度消失

梯度消失是问题中最隐蔽的。假设我们想最小化函数

f

(

x

)

=

tanh

(

x

)

f(x) = \tanh(x)

f(x)=tanh(x),然后我们恰好从

x

=

4

x = 4

x=4开始。正如我们所看到的那样,

f

f

f的梯度接近零。更具体地说,

f

′

(

x

)

=

1

−

tanh

2

(

x

)

f'(x) = 1 - \tanh^2(x)

f′(x)=1−tanh2(x),因此是

f

′

(

4

)

=

0.0013

f'(4) = 0.0013

f′(4)=0.0013。因此,在我们取得进展之前,优化将会停滞很长一段时间。事实证明,这是在引入ReLU激活函数之前训练深度学习模型相当棘手的原因之一。

总结

深度学习的优化充满了挑战,不过我们已经有了一系列表现良好的算法,后面我们会再进行详细介绍。